Mostra sommario Nascondi sommario

Un’app americana che promette di ricreare con l’IA avatar conversazionali dei propri cari scomparsi ha acceso un acceso dibattito online: la novità mette in luce questioni di etica, privacy e il rischio di mercificare il dolore. Negli ultimi giorni la startup dietro il progetto è finita sotto i riflettori dopo la diffusione di un video promozionale che mostra come funzionano i profili digitali.

2Wai, la società che ha sviluppato la piattaforma, ha reso l’app disponibile sull’App Store e annuncia un lancio su Android a breve. Il cofondatore e volto pubblico della startup ha condiviso il filmato su X, dove il servizio ha raccolto subito reazioni contrastanti: chi segnala potenziali benefici emotivi, chi lo giudica sfruttamento commerciale del lutto.

Come funziona l’avatar

Massimo Ambrosini in diretta su eBay Live con SportyCards: appuntamento imperdibile

Pentagono lancia l’allarme su Anthropic: Claude a rischio disattivazione in zone di conflitto

Secondo la descrizione del servizio, bastano circa tre minuti di ripresa in cui la persona si muove e parla per permettere all’algoritmo di apprendere voce, mimica e timbro. L’app crea quindi una versione digitale con cui è possibile scambiare messaggi o conversare a voce, in una simulazione che riproduce tratti somatici e modi di fare.

La piattaforma non si limita ai profili privati: sono già presenti riproduzioni di figure storiche come scrittori e monarchi, proposte come esempi delle potenzialità del prodotto.

Lo spot e la narrazione

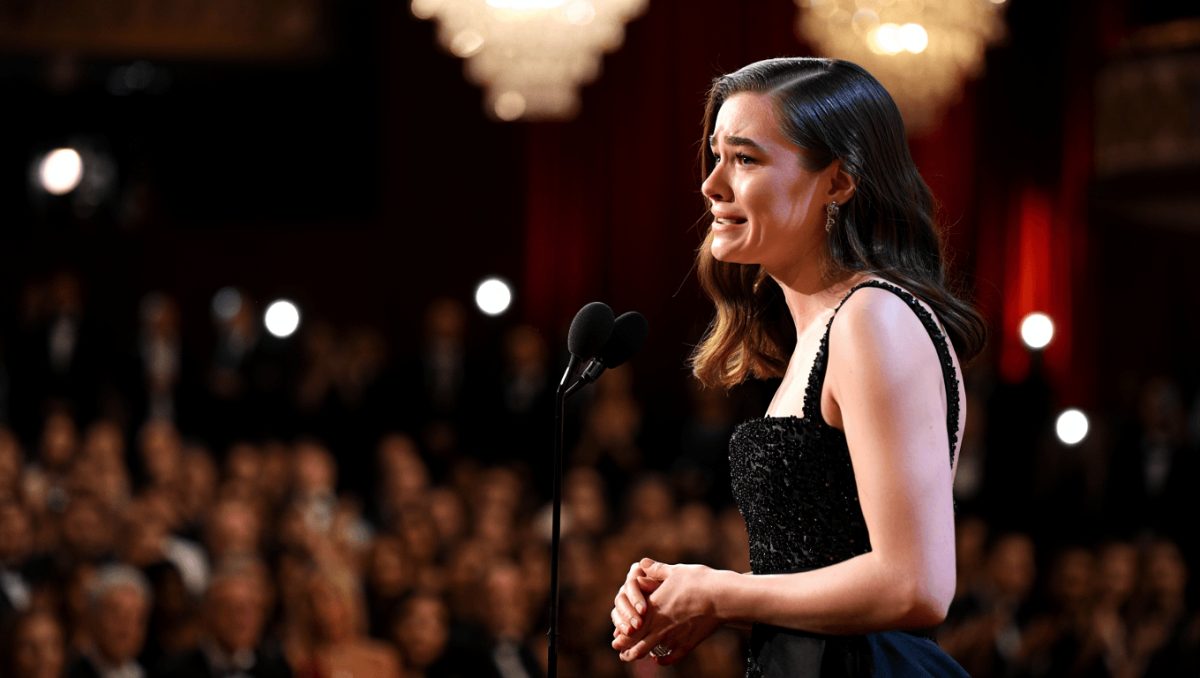

Nel video promozionale una donna registra conversazioni con la madre ancora in vita per trasformarle in un avatar. Il montaggio segue poi una linea temporale familiare — dall’incontro della nonna con un neonato fino agli anni successivi — mostrando momenti intimi che la versione digitale sembra “preservare”.

La scelta narrativa ha amplificato la discussione: il rimando a scenari già esplorati dalla fiction distopica è stato immediato, con numerosi paragoni a un noto episodio di Black Mirror che affronta il tema del ricreare chi non c’è più tramite tecnologia.

Reazioni sui social

La risposta degli utenti è stata in larga parte critica. Commenti su X e altre piattaforme hanno definito l’iniziativa invasiva e poco rispettosa del lutto, sostenendo che il modello di business — download gratuito con avatar “premium” a pagamento — rischia di trasformare il dolore in una fonte di guadagno. Alcuni hanno chiesto maggiore attenzione al consenso e al rispetto della memoria delle persone ritratte.

Altri osservatori hanno invece messo in evidenza potenziali usi terapeutici, ma la discussione resta polarizzata e in molti reclamano regole chiare sull’uso dei dati biometrici e vocali.

Perché questa novità conta oggi

L’arrivo di prodotti che replicano fedelmente voci e volti pone questioni concrete: chi decide se una persona può essere trasformata in avatar dopo la morte? Che tutele esistono per impedire abusi o manipolazioni? E quali sono le ricadute psicologiche per chi interagisce con simulacri di persone amate?

Sul piano pratico, l’uso di registrazioni brevi per generare rappresentazioni realistiche solleva dubbi anche in termini di sicurezza e privacy: i dati biometrici potrebbero essere archiviati, venduti o usati per scopi non previsti, se non ci sono regole stringenti.

Da un punto di vista normativo, l’episodio accende la necessità di un confronto pubblico su limiti e responsabilità delle aziende che sviluppano intelligenze artificiali con impatto diretto sulla vita privata.

Che cosa monitorare

Nei prossimi giorni è probabile che aumentino le richieste di chiarimenti da parte degli utenti, la stampa tecnica chiederà dettagli sulle misure di sicurezza, e potrebbero emergere segnalazioni alle autorità per aspetti legati alla protezione dei dati. Per chi considera di provare l’app è consigliabile leggere con attenzione i termini di servizio e verificare le opzioni relative al consenso e alla cancellazione dei contenuti.

Il caso 2Wai non riguarda solo una singola applicazione: apre un dibattito più ampio sul rapporto tra tecnologia e memoria collettiva, e su come società e istituzioni intendono governare strumenti che possono alterare il modo in cui ricordiamo le persone.