Mostra sommario Nascondi sommario

Un tribunale della Nuova Zelanda ha escluso come attenuante il rimorso prodotto da una detenuta perché le lettere di scuse che aveva consegnato alla corte risultavano in gran parte scritte da un programma di intelligenza artificiale. La decisione riaccende oggi il dibattito sul valore legale e sull’autenticità dei testi generati dalle macchine, con conseguenze pratiche per chi affida all’IA parole dal forte contenuto morale o emotivo.

La vicenda — riportata nelle trascrizioni d’udienza citate dal New York Times — riguarda una donna accusata di incendio doloso, furto con scasso, aggressione e resistenza a pubblico ufficiale. Per cercare di ottenere una riduzione della pena, ha presentato lettere di scuse indirizzate alla corte e alle vittime: testi curati nella forma, ma che il giudice ha identificato come frutto, in larga parte, di software di generazione automatica.

Come il giudice ha scoperto l’inganno

Massimo Ambrosini in diretta su eBay Live con SportyCards: appuntamento imperdibile

Pentagono lancia l’allarme su Anthropic: Claude a rischio disattivazione in zone di conflitto

Secondo quanto emerso, il magistrato di Christchurch ha provato a inserire richieste simili in strumenti di IA e ha riscontrato una sostanziale sovrapposizione con le lettere depositate dall’imputata, anche se queste mostravano piccoli ritocchi. Pur non condannando l’uso dell’IA in sé, il giudice ha ritenuto che un pentimento meccanicamente composto non possa sostituire una dichiarazione autentica davanti alla corte. La donna è stata condannata a 27 mesi di reclusione e dovrà versare tremila dollari neozelandesi a titolo di risarcimento.

La pronuncia solleva una domanda centrale: fino a che punto possiamo rivendicare la paternità di un testo quando la sua stesura è affidata a un algoritmo? E quale peso avranno in futuro le scuse, le dichiarazioni d’intenti o le testimonianze che risultano parzialmente o totalmente elaborate da strumenti digitali?

Un uso sempre più diffuso, rischi concreti

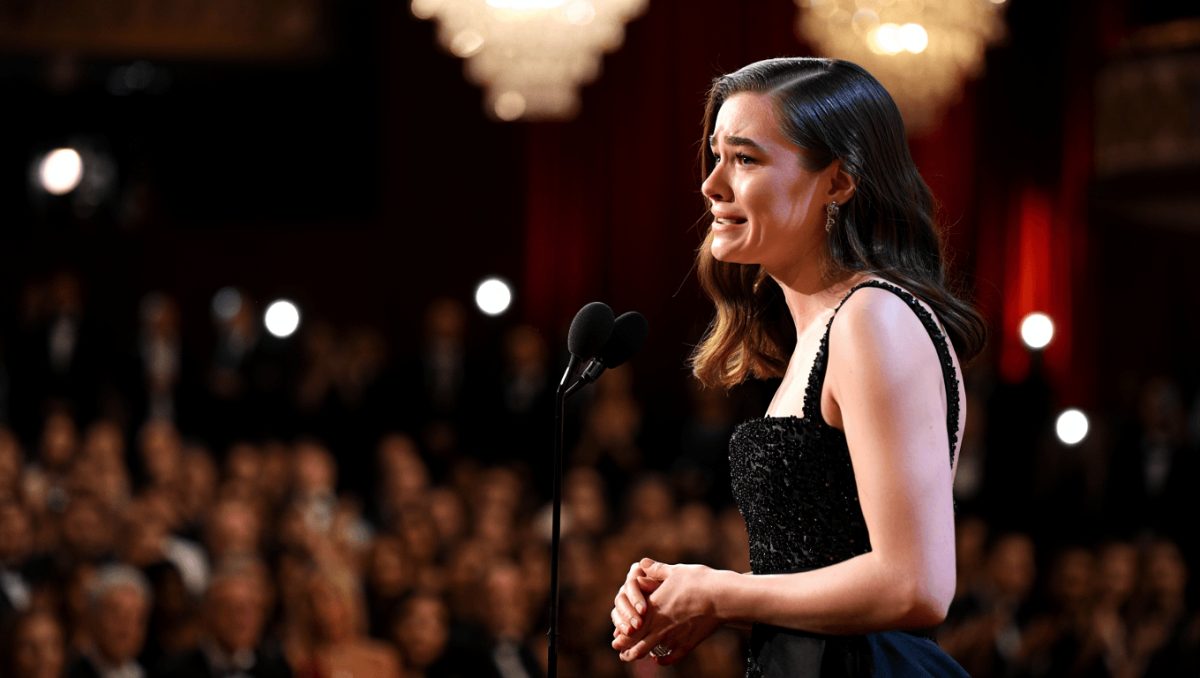

Negli ultimi anni molte persone hanno iniziato a delegare compiti comunicativi delicati all’IA: dal formulare lettere di scuse ai discorsi durante funerali, dalle promesse matrimoniali ai messaggi ufficiali. In questi contesti—dove contano intenzione e sincerità—l’origine del testo assume un valore sostanziale, non solo stilistico.

Al di là delle implicazioni legali, esperti e ricerche avvertono anche di effetti cognitivi legati a un uso precoce e prolungato dell’intelligenza artificiale: si parla di potenziali riduzioni della capacità di pensiero critico, della memoria e delle abilità di elaborazione, talvolta riassunte nel concetto di atrofia cognitiva. A livello istituzionale, report internazionali sottolineano che le capacità delle IA stanno progredendo più rapidamente della nostra capacità di regolamentarle e gestirne i rischi.

Anche dal mondo delle imprese arrivano segnali di allarme: figure coinvolte nello sviluppo e nella sicurezza dell’IA hanno recentemente lasciato ruoli chiave denunciando la difficoltà di far prevalere i valori etici sulle pressioni commerciali. Il messaggio ricorrente è che la società deve sviluppare saggezza e regole al passo con la crescente influenza di queste tecnologie.

Per il pubblico e per chi si trova a interagire con la giustizia, la lezione pratica è chiara: usare l’IA come supporto può essere legittimo, ma quando il contenuto ha rilevanza morale, legale o emotiva è fondamentale che emerga il contributo personale. Le corti potrebbero chiedere sempre più spesso prove di autenticità o valutare con attenzione la genuinità delle dichiarazioni.

Il caso neozelandese non chiude la questione: al contrario, è destinato a stimolare confronti legislativi e linee guida professionali su come trattare testi prodotti dalle macchine. Per ora, chi affida all’IA parole importanti dovrebbe farlo con prudenza e trasparenza, consapevole che la forma non basta quando a decidere è un giudice.